Ecco la seconda parte di questo trittico. Non sarà esauriente come vorrei — la Paleoclimatologia è una materia estremamente complessa — ma spero di riuscire nell’intento di darvi un’idea di come questa scienza funziona.

Oltre la storia: la Paleoclimatica

La realtà è che la climatologia moderna ha due colonne portanti: la paleoclimatologia, che si occupa di ricostruire il clima fino a milioni di anni fa, e l’osservazione moderna, fatta di stazioni al suolo, boe oceaniche, radiosonde, satelliti in orbita e reanalisi 2.

Insieme ricostruiscono una cronologia continua e coerente.

1) Paleoclimatologia: la fisica che legge il passato

La paleoclimatologia non è un’interpretazione a caso: è geochimica applicata. Ogni archivio naturale registra la temperatura attraverso frazionamenti isotopici, rapporti elementari e segnali fisici. Una volta compreso come il frazionamento isotopico risponde alla temperatura, gli archivi naturali diventano veri termometri del passato.

-

Gli isotopi dell’ossigeno: il cuore della paleotermometria

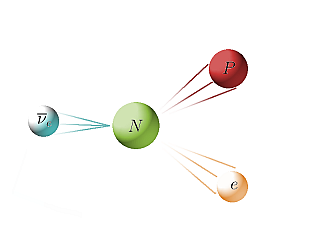

L’isotopo dell’ossigeno-18 ha due neutroni in più, per un totale di 10 neutroni e 8 protoni, rispetto agli 8 neutroni e 8 protoni di un atomo di ossigeno normale. La massa leggermente maggiore di \( ^{18}O\), circa il 12,5 percento in più rispetto al \( ^{16}O\), porta alla differenziazione degli isotopi nell’atmosfera terrestre e nell’idrosfera. Gli scienziati misurano differenze nelle concentrazioni di isotopi dell’ossigeno per rivelare i climi passati. (Illustrazione di Robert Simmon, NASA GSFC)

Gli isotopi dell’ossigeno sono il metodo più robusto per ricostruire temperature passate, sia nei ghiacci che nei sedimenti marini. Qui il parametro chiave si chiama: \(\delta^{18}O\)

\[ \delta^{18}O\;=\left( \tfrac{\left( ^{18}\;O/^{16}\;O \right)_{_{campione}}}{\left( ^{18}\;O/^{16}\;O \right)_{_{standard}}} \;\; -1\right) \cdot 1000 \left[ ‰ \right] \]

Supponiamo che il nostro campione standard (VSMOW [1]) sia: 0,0020052 e che il campione rivelato sia 0,0020102. Avremmo:

\[ \delta^{18}O\;=\left( \tfrac{0,0020102}{0,0020052} -1\right) \cdot 1000 \\ \longrightarrow \left( 1,00249 -1 \right) \cdot 1000 \approx +2,49 ‰ \]

Quindi, il nostro campione ha un eccesso di \( ^{18}O\) di circa 2,49 parti per mille rispetto allo standard VSMOW.

Il legame tra \(\delta^{18}O\) e la temperatura è uno dei principi fondamentali della paleoclimatologia.

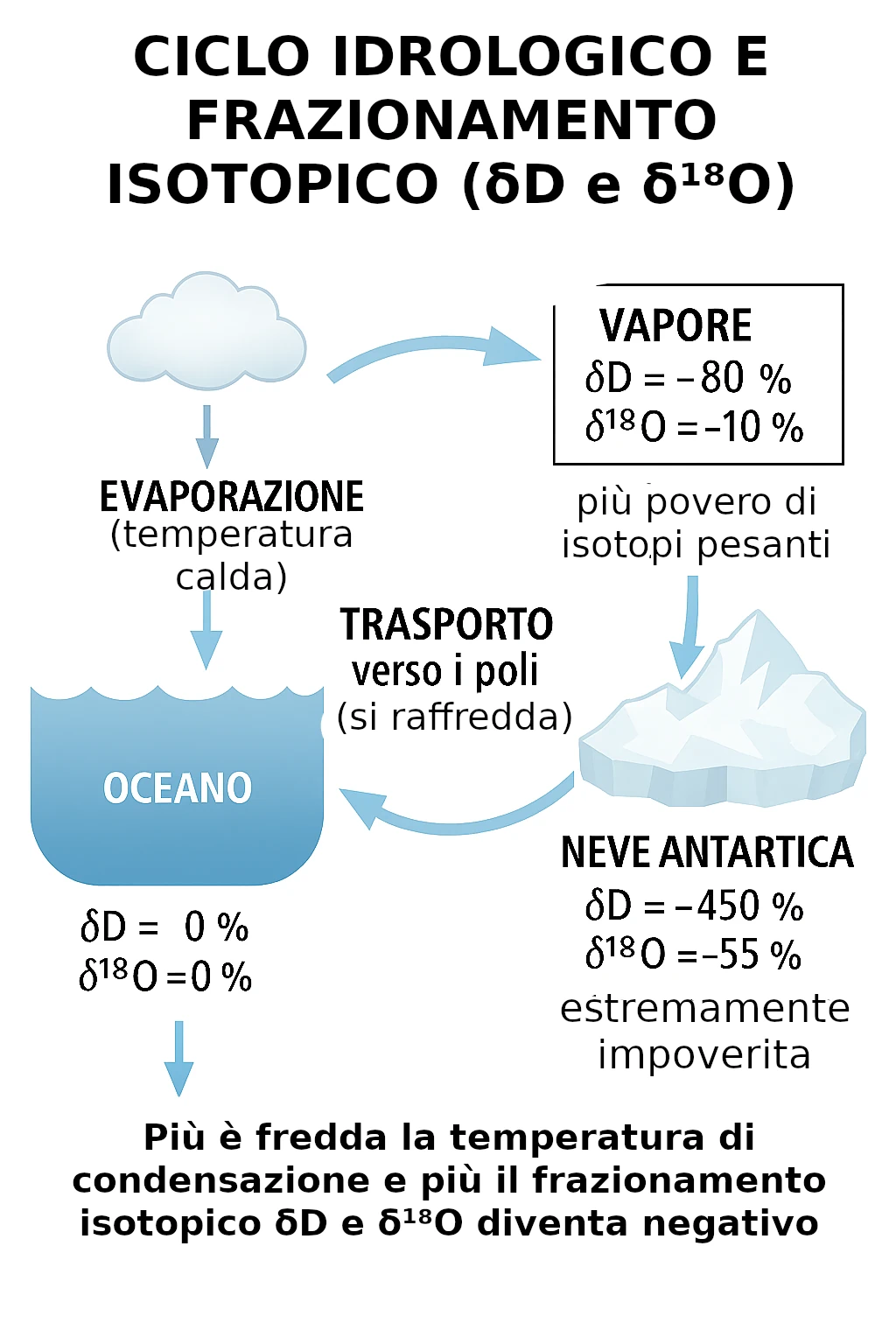

Il meccanismo chiave si basa su un processo fisico-chimico chiamato frazionamento isotopico, che avviene durante i cambiamenti di fase dell’acqua, in particolare evaporazione e condensazione.

L’acqua con \(^{16}O\), più leggera, evapora più facilmente rispetto all’acqua con \(^{18}O\) che è più pesante. Questo perché il legame \(H_{2}^{18}O\) è leggermente più forte, richiede più energia per rompersi.

Il vapore acqueo risultante è quindi impoverito in \(^{18}O\) (\(\delta^{18}O\) più negativo) rispetto all’acqua sorgente (ad esempio l’oceano).

Invece, durante la condensazione, cioè la formazione di pioggia o neve, accade l’opposto: la molecola con \(^{18}O\), più pesante, condensa prima e più facilmente.

Qui entra in gioco la temperatura dell’aria:

Quando fa più caldo, la differenza di energia necessaria per far evaporare \(H_{2}^{18}O\) e \(H_{2}^{16}O\) è minore. Quindi il frazionamento è meno pronunciato. Il vapore che si allontana dall’oceano è meno impoverito in \(^{18}O\), e la pioggia che si forma ha un \(\delta ^{18}O\) meno negativo (è quindi più pesante).

Quando fa più freddo, il frazionamento è invece più forte. Il vapore è molto impoverito in \(^{18}O\), e la precipitazione che ne deriva (soprattutto neve) ha un \(\delta ^{18}O\) molto negativo (è pertanto più leggera).

In sintesi: c’è una relazione approssimativamente lineare tra la temperatura dell’aria alla sede di condensazione e il \(\delta^{18}O\) della precipitazione.

Quando è più freddo, il \(\delta^{18}O\) è più negativo. All’opposto, nei periodi più caldi, il \(\delta^{18}O\) è meno negativo o anche positivo.

Nel periodo caldo attuale il

\(\delta^{18}O\text{è}\approx -55 ‰\), mentre al picco dell’ultima glaciazione scende a

\(\approx -60\;/-62 ‰\) e oltre.

Una differenza di \(\sim 5‰\) corrisponde a un raffreddamento di circa\(8-10\; ^{\circ}C\).

Gli scienziati misurano il \(\delta^{18}O\) in archivi climatici che catturano l’acqua delle precipitazioni del passato:

Carote di ghiaccio (Groenlandia, Antartide): ogni strato di neve accumulata registra il \(\delta^{18}O\) dell’acqua meteorica dell’anno in cui è caduta.

Un \(\delta^{18}O\) più negativo nello strato di ghiaccio indica che l’anno in cui cadde quella neve faceva più freddo rispetto alla media.

Andando in profondità (indietro nel tempo), si vedono le oscillazioni-60 tra periodi glaciali (\(\delta^{18}O\) molto negativo) e interglaciali (\(\delta^{18}O\) meno negativo).

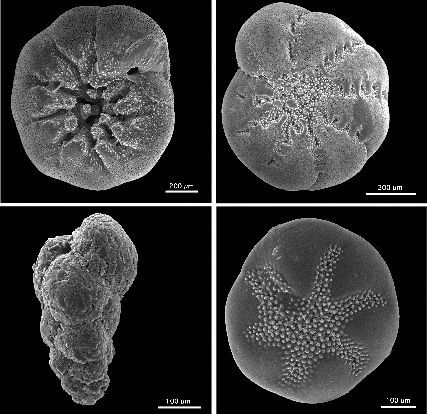

Carote di sedimenti oceanici (foraminiferi):

I microscopici gusci carbonatici (foraminiferi) negli oceani incorporano ossigeno dall’acqua marina.

Il \(\delta^{18}O\) del loro guscio dipende da due fattori:

- La temperatura dell’acqua: in acqua più calda, il frazionamento è minore, quindi il guscio ha un \(\delta^{18}O\) meno negativo.

- Il volume di ghiaccio sulla terraferma: durante le glaciazioni, enormi quantità di acqua con un \(\delta^{18}O\) molto negativo (il ghiaccio) sono bloccate sulle calotte. Di conseguenza, l’acqua oceanica residua diventa più ricca in \(^{18}O\) (\(\delta^{18}O\) più positivo).

L’effetto combinato fa sì che durante un’era glaciale il \(\delta^{18}O\) nei foraminiferi sia più positivo (più pesante), segnalando un mondo più freddo con molto ghiaccio.

-

Idrogeno e Deuterio: il \(\delta D\)

Concettualmente la formula è uguale a quella descritta per gli isotopi dell’ossigeno:

\[ \delta D=\left( \tfrac{\left( D/H \right)_{_{campione}}}{\left( D/H\right)_{_{standard}} }\; -1 \right) \cdot 1000 \left[ \;‰\right] \]

\(D\) è ovviamente l’isotopo pesante dell’idrogeno \(^{2}H\), ovvero un protone e un neutrone.

\(H\) è l’idrogeno \(^{1}H\), un solo protone nel nucleo.

E il riferimento \(D/H\) standard è stabilito dallo stesso usato per l’ossigeno standard: il Protocollo VSMOW.

In pratica il \(\delta D\) indica di quanto il rapporto \(D/H\) si discosta dallo standard in parti per mille.

Per maggiore accuratezza, infatti, quando è possibile si usano i due tracciati indipendenti sullo stesso oggetto di studio: ossia il \(\delta^{18}O\) sa il \(\delta D\). In questo modo si ottiene una doppia conferma del frazionamento isotopico durante il ciclo idrologico e una maggiore sensibilità. Di fatto il frazionamento isotopico tra \(H\) e \(D\) è circa 8 volte maggiore di quella tra \(^{16}O\) e \(^{18}O\), per cui le variazioni di \(\delta D\) sono più ampie e facili da misurare. Combinando le misurazioni dei due frazionamenti si ottiene un parametro chiamato deuterium excess [2].

\[ \text{d-excess} = \delta D -8\delta ^{18}O \]

Il d-excess permette di ricavare informazioni sull’umidità e sulla temperatura della sorgente da cui ha avuto origine l’evaporazione (per esempio il mare), perché il suo valore varia con l’umidità relativa durante l’evaporazione.

-

La relazione empirica di Dansgaard [3]

Nelle carote di ghiaccio antartiche, la variazione del rapporto isotopico del deuterio \(\delta D\)) è proporzionale alla variazione di temperatura dell’atmosfera in cui si è formata la neve.

L’analisi dei dati mostra una relazione approssimativamente lineare:

\[ \Delta T \approx \tfrac{\Delta\delta D}{10} \]

Dove il \(\Delta T\) è la variazione di temperatura in gradi centigradi e \(\Delta \delta D\) è la variazione del rapporto isotopico del deuterio \(\delta D\) espressa in parti per mille.

Questa relazione dice che per ogni \(10\;‰\) di variazione di \(\delta D\) corrisponde a \(\approx 1\;^{\circ}C\) di variazione termica 3.

Nel caso della carota di Vostok lo strato corrispondente all’attuale periodo interglaciale (Olocene, 11.700 anni fa – presente) mostra un \(\delta D \approx -440\; ‰\) e un \(\delta ^{18}O \approx -55,5\; ‰\) , mentre quello del massimo glaciale un \(\delta D\ \approx -480\; ‰\) e un \(\delta ^{18}O \approx -60\; ‰\) (Last Glacial Maximum, LGM), circa 21 mila anni fa). Da questi dati si può stabilire che:

\[ \Delta \delta D = \left( -440 \right) -\left( -480 \right) = + 40‰ \\ \longrightarrow \Delta T \approx \tfrac{+40}{10} = +\;4 ^{\circ}C \]

L’attuale periodo caldo interglaciale (Olocene) è in Antartide, \(\sim 4\;^{\circ}C\) più caldo rispetto all’ultima grande glaciazione 4.

L’attuale periodo caldo interglaciale (Olocene) è in Antartide, \(\sim 4\;^{\circ}C\) più caldo rispetto all’ultima grande glaciazione 4.

Prendendo invece a riferimento il \(\delta ^{18}O\) con la rispettiva relazione empirica di Dansgaard \(\Delta T \approx {\Delta \delta ^{18}O}/{1,2}\), avremmo:

\[ \Delta \delta^{18}O=\left( -55,5 \right) – \left( -60 \right)= 4,5 \,‰ \\ \longrightarrow \Delta T \approx \tfrac{4,5}{1,2} \approx 3,75\; ^{\circ}C \]

anche il frazionamento isotopico \(\delta^{18}O\) restituisce dati coerenti col frazionamento \(D/H\).

Ma attenzione. Le relazioni \(\Delta T = {\Delta \delta D}/{10}\) e \(\Delta T \approx {\Delta \delta ^{18}O}/{1,2}\) sono empiriche, cioè sono calibrate sui dati osservativi e sono fortemente influenzate dalla regione del carotaggio, dalla stagione di riferimento e dai cambiamenti nella temperatura oceanica.

-

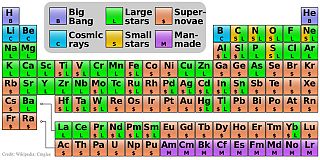

La \(CO_{2}\) dall’Ultimo Massimo Glaciale a oggi

| Durante l’Ultimo Massimo Glaciale (LGM), circa 21.000 anni fa, la concentrazione di \(CO_{2}\) atmosferica era significativamente più bassa rispetto ai livelli preindustriali. Vediamo alcuni dati: Tabella delle concentrazioni atmosferiche di CO₂ dall'Ultimo Massimo Glaciale (185 ppm) fino al 2026 (~430 ppm)

I valori antichi sono medie globali ricostruite, non temperature locali (per esempio la Groenlandia). Il valore del LGM (−6 °C) è una media tra oceani e continenti, con variazioni regionali molto più ampie. Il periodo 1750–1974 mostra un incremento graduale, ma il salto più netto avviene dopo il 1980. Il valore attuale di +1,3 °C è rispetto alla media 1850–1900, coerente con i report IPCC AR6. |

Questi sono i meccanismi principali che riducono la \(CO_{2}\) durante le glaciazioni:

- Aumento della pompa biologica oceanica: Maggiore efficienza nel sequestro di carbonio negli oceani profondi

- Cambiamenti nella circolazione oceanica: Spostamento verso modalità “glaciali” con maggior ventilazione delle acque profonde

- Espansione dei ghiacci marini: Riduzione dello scambio aria-mare alle alte latitudini

- Basse temperature: Maggiore solubilità della \(CO_{2}\) in acqua fredda (legge di Henry [4])

Una differenza di ~100 ppm (da 280 a 180 ppm) fornì una forzante radiativa che, insieme ai feedback associati, contribuì a un raffreddamento di circa \(\approx 2-3\;^{\circ}C\) su un totale di \(4-7\;^{\circ}C\) di raffreddamento globale tra Olocene e Ultimo Massimo Glaciale. Al restante calo contribuirono l’aumento dell’albedo dovuto a una maggiore estensione di ghiaccio e neve, nonché la riduzione di altri gas climalteranti (\(CH_{4}\) e \(N_{2}O\) legati ai processi biologici e alla decomposizione delle piante. In pratica, tutti i feedback climatici (albedo, vapore acqueo, etc.) furono amplificati.

Il livello di \(CO_{2}\) durante LGM (185 ppm) è molto vicino al limite inferiore per molte piante C3 (150-200 ppm), il che avrebbe potuto influire sulla produttività degli ecosistemi 5.

La crescita da 185 a 280 ppm durante la deglaciazione (≈95 ppm in 7.000 anni) è stata molto più lenta rispetto all”attuale aumento di 148 ppm nel solo periodo dell’era industriale.

Questi dati sono tra le prove più solide del ruolo della \(CO_{2}\) come leva fondamentale nel sistema climatico terrestre, sia in passato che oggi.

2) La biomineralizzazione dei foraminiferi

Tutto ha inizio col processo di formazione del guscio calcareo dei foraminiferi.

Questo processo, chiamato biomineralizzazione [5], produce una molecola di calcio \(CaCO_{3}\) partendo da uno ione carbonato \(CO_{3}\;^{2-}\) e ioni di calcio bivalenti \(Ca^{2+}\).

Nell’ambiente marino gli ioni di calcio sono abbondanti ma non i carbonati.

Per sopperire a questa mancanza, i foraminiferi hanno sviluppato una strategia che sfrutta l’anidride carbonica disciolta nel mare e uno ione carbonato \(HCO^{-}_{3}\) per ricavare il carbonato necessario alla mineralizzazione.

Durante questo processo, però, accade qualcosa di cruciale per la paleoclimatologia.

Uno ione magnesio \(Mg^{2+}\), che ha un raggio ionico simile ma leggermente più piccolo rispetto allo ione calcio\(Ca^{2+}\), può sostituirsi a esso nel reticolo cristallino del carbonato. Questa sostituzione non avviene con la stessa facilità a tutte le temperature:

A temperature più basse la barriera energetica per la sostituzione di \(Ca^{2+}\) con \(Mg^{2+}\) nel reticolo cristallino è più alta. Il risultato è che meno \(Mg\) viene incorporato e, di conseguenza, anche il rapporto \(Mg/Ca\) nel guscio risulta basso.

All’opposto, con temperature più alte l’energia termica permette di superare più facilmente la barriera e di conseguenza lo ione \(Mg^{2+}\) può sostituire lo ione calcio. Di conseguenza, il rapporto \(Mg/Ca\) è più alto.

Da qui nasce la relazione esponenziale tra temperatura e rapporto Mg/Ca, spesso espressa come:

\[ \left( \tfrac{Mg}{Ca} \right)_{foram} = A \cdot e^{\left( B \cdot T \right)}\]

Il rapporto\(Mg/Ca\) nei gusci dei foraminiferi è quindi un vero termometro geochimico a memoria lunga. Pur richiedendo correzioni per la chimica oceanica del passato (in particolare per la concentrazione di \(Mg/Ca\) dell’acqua di mare)6, questo proxy permette di separare il segnale termico da quello legato al volume dei ghiacci registrato negli isotopi dell’ossigeno. È uno strumento essenziale per ricostruire in modo quantitativo la temperatura degli oceani del passato.

Questi sono i parametri dell’equazione:

- \(Mg/Ca\) è il rapporto molare Magnesio/Calcio nel guscio del foraminifero

- \(T\) è la temperatura dell’acqua di mare espressa in gradi Celsius

- \(A\) è il valore del rapporto \(Mg/Ca\) a 0 °C (termine pre‑esponenziale);

- \(B\) è la misura di quanto rapidamente cresce \(Mg/Ca\) per ogni grado in più (sensibilità termica).

- \(e\) è il numero di Eulero (2,71828)

I valori di \(A\) e \(B\) variano leggermente a seconda della specie di foraminifero e della chimica dell’acqua (soprattutto il rapporto \(Mg/Ca\) dell’acqua di mare stessa, che è cambiato nel tempo geologico). Non sono inventati, ma derivano da regressioni su colture di foraminiferi e da carote recenti confrontate con la temperatura strumentale.

Per i foraminiferi planctonici 7

Esempio per Globigerinoides ruber [6] :

\[ \tfrac{Mg}{Ca}(mmol/mol)= 0,38 \cdot e^{\left( 0.089 \cdot T \right)} \]

Dove \(T\) è espresso in gradi centigradi.

Per i foraminiferi bentonici 8, invece, la sensibilità generalmente è minore:

\[ \tfrac{Mg}{Ca}=1,2 \cdot e ^{\left( 0,055 \cdot T \right)} \]

-

Come funziona nella pratica

Dai sedimenti marini si estraggono i gusci di foraminiferi, si misura il loro rapporto Mg/Ca con la spettrometria di massa (ICPS-MS o simili 9) e si inverte la formula per ottenere la temperatura:

\[ T=\tfrac{1}{B}\cdot ln \left( \tfrac{\left( Mg/Ca \right)\text{foram\;}}{A} \right)\]

Supponiamo di misurare Mg/Ca = 4,0 mmol/mol in G. ruber.

Usando la calibrazione: \(A\) = 0,38 e \(B\) = 0,089

\[ T= \tfrac{1}{0,089}\cdot ln \left( \tfrac{4,0}{0,38} \right)\\ \longrightarrow 11,24 \cdot ln \left( 10,526 \right) \\ \longrightarrow 11,24 \cdot 2,354 =\;\approx 26.5\,^{\circ}C \]

Un’indagine sul campione di Globigerinoides ruber [7] dimostra che questi foraminiferi sono vissuti in un ambiente tropicale caldo e poco profondo; circa 26 °C.

Rispetto al \(\delta{18}O\), che è influenzato dal ciclo globale del ghiaccio, il paleotermometro \(Mg/Ca\) possiede una diretta sensibilità termica e un’alta risoluzione temporale. Però, se combinati, il\(\delta^{18}O\) e \Mg/Ca\) permettono di separare il segnale termico da quello del volume di ghiaccio.

Il \(\delta^{18}O\) del carbonato di calcio di foraminiferi dipende sia dalla temperatura dell’acqua sia dal volume di ghiaccio continentale, mentre il rapporto \(Mg/Ca\) dipende quasi esclusivamente dalla temperatura. Utilizzando \(Mg/Ca\) per stimare \(T\) e sottraendo l’effetto termico dal \(\delta^{18}O\), si ottiene una stima sommaria indipendente del volume globale del ghiaccio passato. Il principio è questo:

\[ \delta^{18}O_{_{calcite}}\;\; = f\left( T \right) + f\left( \text{volume di ghiaccio globale} \right) \\ Mg/Ca= g(T) \]

E quindi:

\[\ \delta^{18}O_{_{ghiaccio}} \;\;=\delta^{18}O{_{calcite}}-f\left( T \right)\]

Misurando il \(\delta^{18}O\) sui gusci fossili estratti dalle carote di sedimento oceanico 10), si ottengono curve di variazioni glaciali-interglaciali su milioni di anni. Il segnale combina due effetti principali:

- La temperatura dell’acqua — superficiale o profonda — (temperature più basse favoriscono l’incorporazione di \(^{18}O\) nei gusci — \(\delta^{18}O\) positivo), con un effetto di circa -0,22‰ per °C di riscaldamento.

- Il volume globale di ghiaccio (effetto dominante nei cicli glaciali del Pleistocene): durante i periodi glaciali, l’acqua impoverita in \(^{18}O\) si accumula nelle calotte polari come ghiaccio, lasciando gli oceani arricchiti in \(^{18}O\) e quindi i gusci bentonici con valori più positivi.

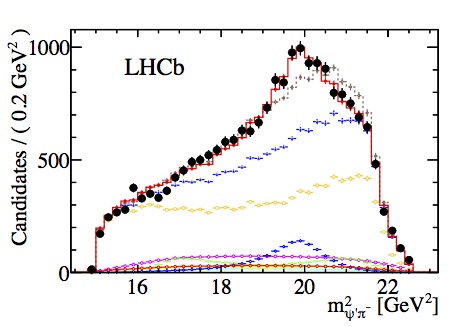

Studi di decomposizione del segnale mostrano che, nel Pleistocene superiore, l’effetto del volume di ghiaccio domina (~50–70% della varianza in \(\delta^{18}O\) bentonico), mentre la temperatura profonda contribuisce in misura minore ma significativa, specialmente nei cicli più brevi. Le curve di riferimento più utilizzate derivano da stack globali di record bentonici, come lo stack LR04 [8], che media 57 registrazioni distribuite globalmente che coprono gli ultimi 5,3 milioni di anni (Pliocene-Pleistocene). Questo stack evidenzia cicli di ~100.000 anni dominanti nel Pleistocene superiore, legati principalmente alle variazioni orbitali di Milankovitch (eccentricità terrestre, che modula obliquità e precessione). Negli ultimi anni sono emersi stack aggiornati e regionali che incorporano più dati (fino a 200+ core) e strategie di modelli di età diverse (tuning orbitale minimo, vincoli geomagnetici, ottimizzazione automatica). Esempi includono grandi database pleoclimatici [9], con versioni globali, Atlantico e Pacifico, che confermano il dominio del ciclo 100-ka post-MPT ma evidenziano divergenze regionali nella \(\delta^{18}O\) bentonica (es. differenze tra Atlantico e Pacifico dovute a circolazione profonda). Questi nuovi stack offrono maggiore flessibilità per allineamenti stratigrafici senza sovraccaricare il tuning astronomico.

-

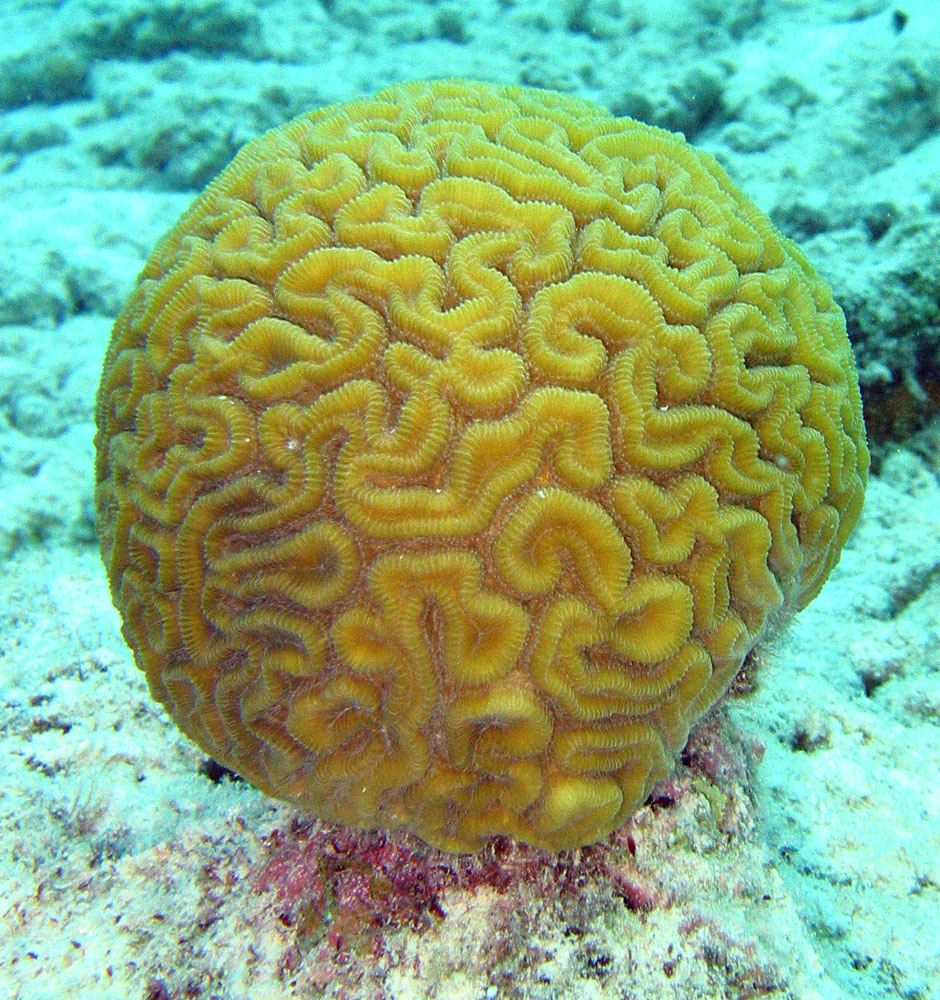

Il rapporto \(Sr/Ca\) nei coralli

Il rapporto Stronzio/Calcio negli scheletri di corallo rappresenta un altro paleotermometro di alta precisione per le temperature superficiali oceaniche tropicali 11

I coralli costruttori di barriera (sclerattinie) come Porites e Diploria secernono uno scheletro di aragonite (una forma di \(CaCO_{3}\)). Durante la biomineralizzazione incorporano oligoelementi dall’acqua marina, ioni di calcio \(Ca^{2+}\) e, in tracce, ioni di stronzio \(Sr^{2+}\) [10].

Il rapporto \(Sr/Ca\) registrato nello scheletro varia in modo sistematico e quasi lineare con la temperatura dell’acqua superficiale del mare: più l’acqua è calda, più basso è il rapporto \(Sr/Ca\) incorporato. Questa relazione inversa si esprime empiricamente come \[ Sr/Ca \approx A − B \cdot T\], dove \(T\) è la temperatura in °C e \(B\) (la sensibilità) è tipicamente tra 0.06 e 0.08 mmol/mol per grado Celsius, a seconda della specie [11].

In altre parole, \(A\) è determinato dai dati, non scelto a piacere: cambia da specie a specie e da sito a sito, ed è calcolato statisticamente insieme alla pendenza \(B\). Per coralli tropicali come Porites, i valori tipici di \(A\) risultano intorno a 9.8–10.2, coerenti con \(Sr/Ca\) osservati (8.6–9.2 mmol/mol) e le temperature delle acque superficiali tropicali (24–30 °C).

Il motivo fisico principale è legato alle dimensioni degli ioni: lo ione \(Ca^{2+}\) ha un raggio ionico di circa 1.00 Å, mentre \(Sr^{2+}\) è più grande (1.18 Å) e quindi meno compatibile col reticolo dell’aragonite. A temperature più alte la crescita cristallina è più rapida e la struttura discrimina più efficacemente contro gli ioni sovradimensionati, la crescita del cristallo è più rapida escludendo lo stronzio e abbassando il rapporto \(Sr/Ca\). A temperature più basse, invece, la crescita rallenta e l’aragonite accetta più facilmente anche gli ioni leggermente sovradimensionati come gli \(Sr^{2+}\), aumentando il rapporto \(Sr/Ca\).

Si tratta quindi di un classico processo di frazionamento elementare dipendente dalla temperatura, che rende \(Sr/Ca\) un paleotermometro affidabile per ricostruire variazioni stagionali e interannuali con risoluzione sub-annuale. Quando l’acqua è più calda, gli organismi incorporano meno stronzio rispetto al calcio; analizzando questo rapporto nei fossili, gli scienziati possono ricostruire le temperature oceaniche degli ultimi secoli e millenni.

Pur richiedendo attenzione a potenziali effetti diagenetici e fisiologici, questo proxy ha illuminato la dinamica di fenomeni climatici come ENSO (El Niño-Southern Oscillation), documentando l’eccezionalità del riscaldamento oceanico moderno nel contesto storico recente.

Ipotizzando un rapporto \(Sr/Ca\) di 8,80 mmol/mol e usando una calibrazione\(Sr/Ca =10,0 -0,05 T\) [12] si ottiene:

\[ T = \tfrac {10,0 – \tfrac{Sr}{Ca} }{0,05} \\

\rightarrow T=\tfrac{1,20}{0,05} = 24\,^{\circ}C \]

3) Gli speleotemi (stalattiti e stalagmiti)

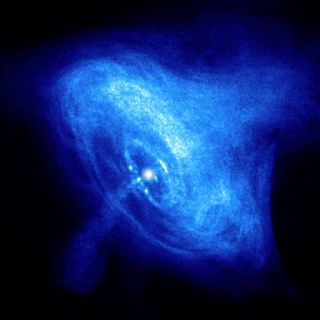

Formazione di stalattiti nella grotta di Avshalom (Israele)

By Sir_Joseph – Own work, CC BY-SA 3.0, https://commons.wikimedia.org/w/index.php?curid=72897795

Gli speleotemi sono l’archivio terrestre ad alta risoluzione.

Accanto agli archivi marini (foraminiferi e coralli), i depositi carbonatici nelle grotte — speleotemi (stalagmiti, stalattiti e altre concrezioni calcaree) — rappresentano uno degli archivi paleoclimatici più precisi disponibili sul continente. Sono il complemento terrestre degli archivi marini (foraminiferi, coralli), ma con una sensibilità completamente diversa: non integrano l’oceano globale, bensì l’idrologia locale. Crescono per precipitazione di calcite (o aragonite) da acqua di percolazione, registrando con precisione cronologica (grazie alla datazione \(U-Th\) 12) le variazioni di precipitazione, temperatura e circolazione atmosferica su scala regionale.

A differenza dei foraminiferi, che integrano segnali oceanici globali, gli speleotemi catturano soprattutto l’idrologia terrestre: intensità dei monsoni, quantità della pioggia e, in alcuni casi, pure la temperatura locale.

-

Il proxy principale: il \(\delta^{18}O\) nella calcite

Il \(\delta^{18}O\) dello speleotema dipende da due fattori principali:

- Il \(\delta^{18}O\) dell’acqua di gocciolamento riflette il relativo frazionamento isotopico della pioggia locale. Quindi il fattore quantità (“amount effect” nella letteratura scientifica) nelle regioni tropicali, la temperatura di condensazione, traiettoria delle masse d’aria 13, evaporazione e rievaporazione lungo il percorso.

Più che un proxy termometrico, è quindi un proxy idrologico, almeno nella maggior parte dei casi. - Il frazionamento isotopico temperatura-dipendente durante la precipitazione della calcite.

\[ \delta^{18}O_{\text{calcite (SMOW)}}\;\; \approx \delta^{18}O_{\text{acqua}}+ \left( \tfrac{16,1 \times 1000}{T} – 24,6 \right) \]

dove \(T\) questa volta è espresso in Kelvin. Qui il \(\delta^{18}O\) dell’acqua è la parte idrologica, mentre il frazionamento di equilibrio è correlato alla temperatura.

In pratica, tuttavia, i due effetti risultano strettamente interconnessi e spesso non possono essere distinti senza il ricorso a ulteriori proxy, quali \(\delta^{13}C\), \(Mg/Ca\), \(Sr/Ca\), inclusioni fluide e modelli di bilancio idrico.

Cosa “misura” davvero il \(\delta^{18}O\) negli speleotemi?

|

Un aspetto spesso trascurato riguarda il fatto che gli speleotemi non rappresentano termometri puri. Numerosi divulgatori, e talvolta anche articoli scientifici redatti con eccessiva fretta, descrivono il \(\delta^{18}O\) degli speleotemi come un diretto indicatore della temperatura, il che risulta fuorviante.

La temperatura interviene unicamente nel processo di frazionamento acqua–calcite, con un’influenza relativamente ridotta rispetto alle variazioni del \(\delta^{18}O\) presenti nelle precipitazioni. Di conseguenza:

- Negli ambienti tropicali il\(\delta^{18}O\) riflette quasi esclusivamente fattori idrologici;

- Alle medie latitudini si osserva un insieme complesso di influenze;

- Solo in condizioni climatiche molto fredde e stabili il \(\delta^{18}O\) può avvicinarsi a un indicatore termometrico.

Gli speleotemi e i foraminiferi rappresentano due archivi paleoclimatici complementari, in grado di fornire informazioni distinte ma integrabili per ricostruire le dinamiche climatiche del passato. I foraminiferi, organismi marini con guscio calcareo, registrano il segnale isotopico dell’oceano globale, permettendo di dedurre variazioni della temperatura superficiale e del volume dei ghiacci.

Gli speleotemi, concrezioni minerali che si formano nelle grotte, incorporano invece il segnale isotopico dell’acqua meteorica, rivelando indicazioni sull’idrologia regionale e sulla circolazione atmosferica. L’integrazione di questi due proxy consente di ottenere un quadro più completo e dettagliato di fenomeni come la dinamica dei monsoni, gli spostamenti della Zona di Convergenza Intertropicale (ITCZ), i pattern di teleconnessione climatica (ENSO, NAO) e le risposte dei sistemi continentali ai cambiamenti globali.

Le condizioni attuali (clima moderno) indicano una temperatura media in grotta: \(T\) di circa \(19^{\circ}C \Rightarrow 292 K\)

Gli isotopi dell’acqua di gocciolamento: \(\delta{18}O_{\text{acqua}}\; \approx −5,0 ‰\) (valore tipico per il Mediterraneo orientale)

Pertanto, calcolando il termine di frazionamento si ottiene:

\[ \frac{16,1 \times 1000}{292}- 24,6 \\\longrightarrow \;

\approx 55,1 -24,6 \\ \longrightarrow \; \approx 30,5‰ \]Ne consegue che, oggi, la \(\delta^{18}O_{\text{calcite}}\;\text{ è} \approx -5,0 + 30,5 = + 25,5‰\)

Ipotizzando una temperatura in grotto sia circa la stessa(\(19 ^{\circ}C\)), invertendo la relazione si otterrebbe:

\[ \delta^{18}O_{\text{acqua}\;_{\text{passato}}}\;\;\; \approx \delta^{18}O_{\text{calcite}\;_{\text{passato}}};\; \; – 30,5 \\\longrightarrow 27,0-30,5 \\\longrightarrow -3.5‰ \]Questo significa che l’acqua di gocciolamento nel passato risultava circa essere 1,5 ‰ più pesante (−3.5 ‰ rispetto a −5.0 ‰) rispetto a oggi. In un contesto simile a quello delle grotte di Avshalom o Soreq, questo dato è coerente con una fase climatica più umida, caratterizzata da un maggiore apporto di intense piogge autunnali e invernali e da una diversa combinazione di masse d’aria rispetto ad oggi.